archiv: 2026 ×

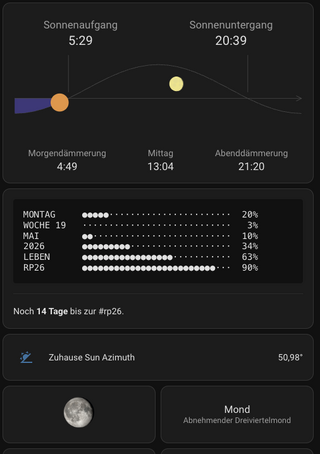

mond

in meinem home assistant dashboard lasse ich mir den sonnen- und mondstand anzeigen. der sonnenstand ist praktisch, weil ich dann weiss, ob wann morgens die sonne aufgeht. weil es mich erfreut, hatte ich dort auch immer ein schematisches bild des mond, wie …

Das ist der eigentlich gefährliche Punkt: Menschen haben schon immer Unsinn gedacht. Das gehört einfach dazu. Aber digitale Plattformen haben aus fast jeder Abweichung, jeder Kränkung, jeder Wut und jeder Verschwörungsfantasie sofort einen scheinbaren sozialen Raum gebaut.

das ist ein sehr schön differenzierter und nachdenklicher text von florian heinz über räume. räume im netz, in kneipen, im digitalen und im analogen. aber ich würde gerne etwas undifferenziert, bzw. kurz angebunden widersprechen.

die räume, in denen wir menschen interagieren, sind alle synthetisch, also von uns menschen konstruiert und mit regeln versehen. digitale räume sind lediglich eine weitere ausprägung.

manche räume haben eine jahrtausendealte geschichte hinter sich, und alle unterliegen einem steten wandel. ich war immer fasziniert von der idee der kaffeehäuser, orte, an denen sich kluge menschen treffen, diskutieren, ideen entwickeln und streiten. aber gibt’s das noch? starbucks und andere kaffeehausketten leben zum teil von dieser nostalgie, aber ich würde sagen: so wie sich die digitalen räume ständig wandeln, wandeln sich auch die analogen räume, die gastronomischen, politischen, kulturellen orte.

ich sehe das problem eher darin, dass wir die digitalen räume noch nicht sozialisiert haben, noch nicht die richtigen regeln, den richtigen umgang damit gelernt haben. in meiner jugend hatten wir ein gutes gefühl dafür, welche öffentlichen orte wir lieber meiden und in welche wir passen. ganz platt gesagt: nazi-kneipen gab’s auch schon vor dem internet. agitieren, radikalisieren, verschwörungstheoretisieren geht, das zeigt die geschichte, auch ganz gut mit analogen mitteln.

und, nur so ein gedanke: virtuelle soziale räume gab’s auch schon lange vor dem internet. die virtuellen, gedachten räume, die gesprochene oder geschriebene erzählungen öffnen, unterscheiden sich meiner meinung nach nicht substanziell von den neuen digitalen räumen, die sich in den letzten 20–30 jahren geöffnet haben. es gab immer wieder katalysatoren, turbolader, die die alten regeln über den haufen warfen und für aufregung, umbrüche und teils radikale veränderung sorgten. die erfindung des buchdrucks oder kürzlich des internets und jetzt unsere fähigkeit, künstliche neuronale netze mit vorher gedachtem, gemachtem oder aufgeschriebenem zu füttern — all diese umbrüche erforderten und erfordern anpassungen von gesellschaftlichen normen und regeln, um negative effekte abzuschwächen.

ja, ich sehe auch, dass aus digitalen räumen viel toxisches, übelriechendes kommt und dass die brutstätten der demokratiefeindlichkeit und ausländerfeindlichkeit sich zum großen teil in digitale räume verlagert haben. aber das muss nicht unbedingt an den strukturellen gegebenheiten der räume liegen, sondern in erster linie daran, dass wir als gesellschaft den umgang mit diesen räumen noch nicht gelernt haben. oder dass die radikalen schneller lernen, anpassungsfähiger, flexibler sind als die moderaten.

trotzdem: man kann nicht zu viel darüber nachdenken oder diskutieren, wie unsere sozialen räume funktionieren oder funktionieren sollten.