(via)

tag: ai ×

ich kann meine empfehlung für ole reissmanns THEFUTURE nicht oft genug wiederholen. einer meiner favoriten in meinem feedreader.

hier zitiert er martin schori:

A worn but often-quoted line about AI goes: “AI won’t take your job, but someone who knows how to use AI might.”

Swedish researcher Emma Frans has come up with a better version: “AI won’t take your job, but someone who’s more fun to hang out with will.”

links und likes vom 05.03.2026

indiskretionehrensache.de: Holy Smokes! Ich starte einen Newsletter von der SXSW

wenn ich böse wäre, würde ich schreiben: thomas knüwer arbeitet jetzt für die republica und braucht offenbar geld. bin ich aber nicht mehr (böse), nur noch doof. tatsächlich finde ich …

ich habe zuerst nur die zitate gelesen, die volker weber aus barbara geyers text extrahiert hat und eine replik im kopf formuliert. dann fiel mir auf, dass das äusserst denkfaul ist und las barbara geyers text. der text gefiel mir, aber meine replik bleibt die gleiche. einer der hauptgedanken in barbara geyers text ist dieser:

Ich nenne dieses Phänomen die KI-Fachkompetenzschwelle. Eine Grenze des Vorwissens, unterhalb derer KI-Nutzung nicht nur wirkungslos wird, sondern kontraproduktiv.

kritisches denken allein reiche nicht, man müsse schon substanzielles wissen mitbringen, um KI produktiv, nutzbringend zu nutzen — sagt barbara geyer. ich würde darauf antworten, dass das auch alles eine haltungsfrage ist. für mich ist der weg zu wissen neugier, also eine haltung (so wie kritisches denken auch eine haltung ist). neugier führt dazu, dass ich mich mit einfachen antworten, egal woher die kommen, nicht zufrieden gebe, sondern verstehen möchte und im besten fall etwas so tief verstehen möchte, dass ich es selbst machen oder anderen erklären kann.

wer neugierig ist gibt sich nicht mit wohlklingenden antworten eines lehrers, professors, eltern, buchs, videos oder einer KI zufrieden. neugier inspiriert zum tiefer, weiter fragen. dummerweise kann man neugier nicht (wirklich) lehren (oft im gegenteil), neugier kann man aber wecken, entfachen.

witzigerweise habe ich gerade heute beim morgenspaziergang an meinen kunstlehrer in der siebten oder achten klasse zurückgedacht. herr schiefer hiess er und alles was er uns an aufgaben antrug, entfachte neugier und aha-erlebnisse in mir. wir haben graustufenbilder aus punkten gemalt, benutzbare stühle aus pappe gebaut, dioramen im schuhakarton mit gucklöchern gebastelt.

bei herrn schiefer habe ich kein kritisches denken beigebracht bekommen, aber er hat neugier in mir geweckt, die dann auf dem weg auch kritisches denken ausbildete und dann langfristig zu einer anhäufung grösstenteils unnützen wissens in mir geführt hat.

was ich sagen will: wenn man KI nur zur generierung von antworten nutzt, wird ki schnell kontraproduktiv. wenn man KI zur generierung weiterer fragen nutzt kann man mit KI unterstützung sehr viel lernen.

Turns out that LLMs are good at de-anonymization:

links und likes vom 01.03.2026

youtube.com: Is AI Hiding Its Full Power? With Geoffrey Hinton

das erschreckende an KI scheint mir in erster linie zu sein, dass es menschen und formen gibt die sich tatsächlich auf die antworten und schlussfolgerungen dieser systeme verlassen und die entscheidungen dieser systeme von menschen nicht überstimmt (oder nchvollzogen) werden können. damit scheinen wir einen kritischen kipppunkt zu überschreiten und legen bereits jetzt potenziell existenzielle entscheidungen in die hände von black boxes. damit kafkaeskisieren wir die welt mindestens um den faktor 2.

links und likes vom 20.02.2026

terrygodier.com: Current | Terry Godier

The river is what's here right now. You scroll through it, save what you want to keep, and let the rest go.

current ist ein RSS reader mit nem neuen dreh, eben diesem river und artikeln die eine lebensdauer haben und dann …

Diese Verschiebung ist medientheoretisch nicht neu. Wir haben sie bereits bei Suchmaschinen erlebt, die Inhalte nicht mehr vermittelten, sondern ersetzten, indem sie Zusammenfassungen an die Stelle der Quelle setzten. Mit LLMs wird dieser Schritt radikalisiert: Aus der Verweisstruktur des Netzes wird eine Extraktionslogik. Texte werden nicht mehr gelesen, sondern ausgebeutet, ihr Kontext verschwindet im Antwortformat.

(via)

content, ozempic, das alte web

markus unterscheidet zwischen schreiben und „content“-erstellung:

mequito.org: [Mo, 16.2.2026 - Blase, generative KI]

Ich verfasse aber Texte und Sätze, weil ich mich ausdrücken will, weil ich etwas mitteilen will. Wenn das eine generative KI für mich …

Ich verfasse aber Texte und Sätze, weil ich mich ausdrücken will, weil ich etwas mitteilen will. Wenn das eine generative KI für mich macht, dann würde ich einfach Content produzieren, meine persönliche Ebene ginge darin verloren, mein Gedankengang, meine Idee, meine Formulierung und eventuell auch meine Fehler. Content muss nicht verwerflich sein, aber das will ich dann nicht als meinen Ausdruck darstellen. Vermutlich ist mein Wunsch, authentisch zu sein, größer als der Wunsch, Content zu produzieren. Und das will ich auch von anderen Leuten. Ich will authentische Leute um mich herum, keine Hüllen, die nur etwas darstellen.

gern gesehen, gern gelesen und gefavt

realvirtuality.info: Was tun mit KI?

hier schreibt @alexmatzkeit sehr differenziert und nachvollziehbar über seine KI nutzung und streift dabei auch ein paar aspekte, die bei diskussionen über KI oft übersehen werden. sehr gerne gelesen.

bookmark

Plur …

Once men turned their thinking over to machines in the hope that this would set them free. But that only permitted other men with machines to enslave them.

― Frank Herbert, Dune, ca. 1965

in dune war deshalb kopfrechnen ein grosses ding.

bald kommt …

”Once, men turned their thinking over to machines in the hope that this would set them free. But that only permitted other men with machines to enslave them.”

I started listening to the audiobook of Dune the other day. This quote felt very timely.

hier schreibt @alexmatzkeit sehr differenziert und nachvollziehbar über seine KI nutzung und streift dabei auch ein paar aspekte, die bei diskussionen über KI oft übersehen werden. sehr gerne gelesen.

nicht gelesen, nicht gesehen, keine komplimemte

gestern machte ai;dr die runde. @dave_minnigerode hat das naheliegende möglicherweise erstmals aufgeschrieben, nämlich das er einen text nicht lesen mochte, nicht weil er zu lang war (too long, didn’t read, tl;dr), sondern weil er zu sehr nach ki/ai roch …

nachdem ich bei @eay in einer fussnote über openclaw gelesen habe, habe ich openclaw auch mal kurz angeguckt, aber nach 6 stunden entnervt wieder die kralle geschlossen.

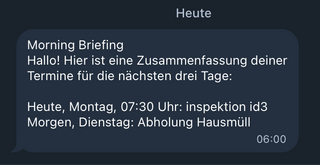

automatisierungen mache ich lieber mit home assistant und das hier ging dann auch …

dann ist, so gesehen, james tiberius kirk eine allegorie auf die menschheit.

dieses video könnte man durchaus als KI 101 bezeichnen. der gast dieser folge startalk mit neil degrasse tyson und seinen beiden sidekicks ist geoffrey hinton, der letztes jahr für seine grundlagenforschung zu neuronalen netzwerken den physik nobelpreis bekommen hat. er erklärt ein paar der grundlagen kündtlicher neuronaler netzwerke und warum er denkt dass KIs bereits denken. zu den grundlagen fand ich folgendes faszinierend:

das menschliche gehirn hat ungeführ 100 trillionen (noronale) verbindungen. wenn man das mit dem zeitraum den wir leben vergleicht (um die 2,5-3 milliarden sekunden), kann man sagen: wir haben sehr viele verbindungen, aber wenig erfahrung.

bei den neuronalen netzen die wir derzeit zu bauen imstnde sind ist das umgekehrt. sie haben ca. 1 milliarde verbindungen (viele LLMs haben sehr viel weniger weniger), was ungefähr 1% der verbindungen sind, die menschen haben. dafür haben diese künstlichen neuronalen netze und LLMs viele tausend mal mehr erfahrenungen.

die grenzen an die heutuge LLMs stossen hängen (laut geoffrey hinton) vor allem damit zusammen, dass sie auf erfahrungen basieren die wir aufgeschrieben haben. eine go KI, die aus erfahrungen echter go-experten/meister gelernt hatte, war immer etwas schlechter als die menschlichen experten. unschöagbar wurden diese KI-systeme als sie anfingen gegen sich selbst zu spielen, sich ihre erfahrungen also selbst beigebracht haben. das dürfte auch de weg sein, wie LLMs klüger werden, meint geoffrey hinton.

wirklich sehenswert, wenn man KI abseits des hypes und gegen-hypes etwas besser verstehen möchte.