KI tagebuch 03.06.2026

heiko erzählt hier wie er KI nutzt, unter anderem um sein blog zu bauen.

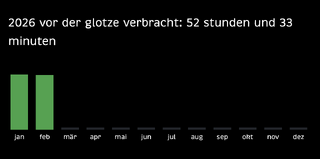

Ich habe in den letzten Wochen sehr viel KI genutzt. Ich glaube, das wird auch nicht mehr so schnell aufhören. Es wird ein Werkzeug werden und ich werde gleichzeitig als Nutzer, Konsument, Bürger oder Angestellter immer öfter mit KI konfrontiert sein.

[…]

Ich versuche ab jetzt hier im Blog immer mal wieder aufzuschreiben, was mir mit KI passiert ist, was ich damit gemacht habe, wo es fürchterlich war. Höchstwahrscheinlich werden viele Sachen sehr schnell, sehr schlecht altern.

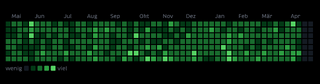

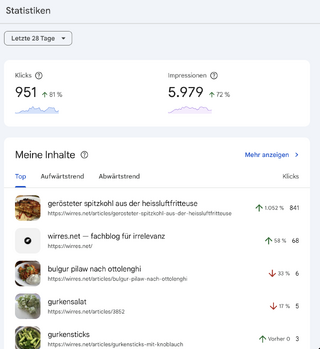

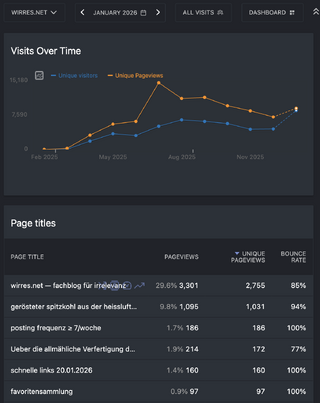

ich finde das eine hervorragende idee festzuhalten wie ich KI nutze und wie sich das über die zeit gegebenenfalls ändert. vor allem wenn ich bedenke, was sich in den 14 monaten seit meinem ersten mit kirby veröffentlichten artikel getan hat. wenn ich mich recht erinnere, habe ich damals, also vor etwas über einem jahr zwar gelegentlich schon chatGPT benutzt, aber zum beispiel das migrationsscript noch klassisch gebaut: selbst googlen, gefundene scripte umbauen, testen, mehr googlen, mehr testen, weiter umschreiben, debuggen und optimieren. sehr geholfen haben mir bei der planung und umsetzung der neuen wirres.net-version zuerst auch bastian allgeiers kirby tutorials. ich habe von bastian viel über kirby gelernt und vor allem über strukturierte und saubere php-programmierung. und ich habe damals sehr, sehr viel selbst am code gemacht.

gelegentlich habe ich dann auch chatGPT im chat-modus um code-snippets gebeten, aber das copy&pasten und die korrekturschleifen wurden dann sehr schnell lästig und ich habe mir von chatGPT erklären lassen wie ich VS-code als programmierumgebung, inklusive chatGPT unterstützung einrichten und nutzen kann.

VS-code war dann für mich ein game changer. ich habe immer schon direkt alles auf dem live-server „entwickelt“, per SFTP client und BBEdit. da VS-Code auch direkt auf dem server laufen kann (per SSH), habe ich dann mit VS-code zu zweit, also mit unterstützung von chatGPT direkt auf dem live-server am code gearbeitet. mit VS code ist das wirklich angenehm, transparent und aus meiner sicht auch sicherer als mein gefrickel vorher: alle codeänderungen werden im editor markiert und sind reversibel. zusätzlich habe ich angefangen änderungen mit git (auf dem server) lokal zu versionieren.

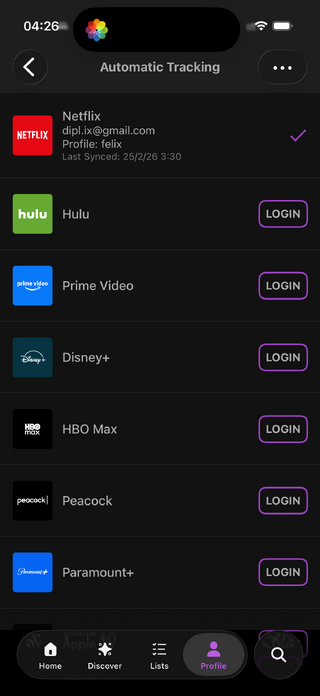

so habe ich monatelang an wirres.net rumgeschraubt bis mir irgendwann cursor über den weg lief. cursor nutzt im prinzip auch VS-code, aber dahinter sind sehr viele mögliche LLMs. ich bezahle cursor eine monatliche gebühr und kann dafür eine grosse auswahl an agents nutzen, nämlich die, die der cursor agent gerade für geeignet für die aufgabe hält.

Ich bin kein einzelnes Modell, sondern der Agent-Router in Cursor. Ich lese euer Setup, führe Befehle aus, ändere Dateien und denke mit.

in der regel lasse ich die agentenauswahl auf auto. aber gelegentlich, wenn die automatisch ausgewählten agents nicht so arbeiten wie ich das wünsche, stelle ich eine weile auf teurere und besser mitdenkende agents um, deren nutzung bei meinem abo-modell allerdings begrenzt ist.

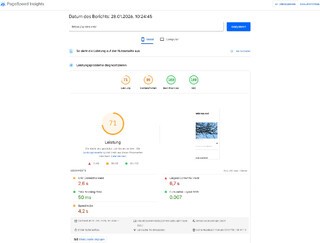

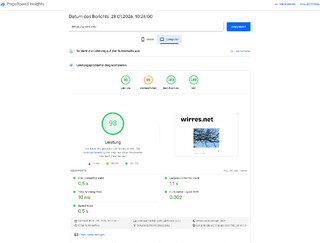

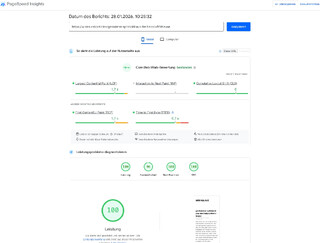

seit der umstellung auf einen hetzner server, sind hier und da performance probleme sichtbar geworden die vorher nicht ins gewicht fielen. die standard (auto) agents haben da teilweise keine befriedigenden lösungen oder ansätze gefunden. eine explizite umstellung auf (claude) opus-4.8 hat dann sehr viel klügere und strukturiertere vorschläge geamacht, die so effektiv waren, dass die grundlast des servers von einem lauten rauschen zu einem leisen plätschern geworden ist.

das scheint mir das wirklich gute an cursor zu sein: ich muss nicht bei mehreren KI-firmen konten anlegen und geld zahlen — und kann sie trotzdem alle nutzen.

heiko deutet das auch an: es ist wichtig zu wissen was man will und wie das alles grundsätzlich funktionieren soll. dann kann man KI-agenten als sparringspartner mitdenken lassen und ideen umsetzen lassen. die KI denkt manchmal in absurde oder viel zu komplizierte richtungen. aber wenn ich die arbeit wie ein architekt angehen, also einen plan und das grosse und ganze im kopf habe, dann kann man die KI wie einen handwerker oder fachingenieur nutzen.

seit ein paar wochen nutze ich cotypist, das ist eine KI die lokale modelle nutzt um beim tippen wort- oder satzvervollständigungen zu machen. das hilft mir vor allem dabei mit weniger buchstabendrehern zu schreiben und gelegentlich einen ticken schneller zu schreiben. das ist ein bisschen so wie das tippen auf dem iphone, nur etwas besser und kontext-sensibler als das was apple in iOS bietet. kein game changer, aber sehr praktisch.

was meine texte hier auf wirres.net angeht oder meinen vortrag: ich schreibe alles selbst. aber ich habe gemerkt, dass ich LLMs als resonanzraum, einschätzer, zusammenfasser und plausibilitätschecker sehr gerne nutze. für längere texte oder meine republica sessions neige ich dazu mir wahnsinnig viele notizen zu machen und dann gelegentlich den überblick über meine notizen und quellen zu verlieren. da sind LLMs, oder cursor, teilweise sehr hilfreich um mich in meiner gedankenwelt zu orientieren und mir meine eigenen notizen kurz und knapp zu erklären.

gelegentlich habe ich LLMs gebeten meinen schreibstil zu imitieren, aber das hat bisher noch nie ein befriedigendes ergebnis gebracht. vor ein paar jahren habe ich übrigens etwas ähnliches gemacht, nur dass da nicht ein LLM meinen schreibstil imitieren sollte, sondern eine ghostwriterin. auch das hat damals nur so mittelprächtig funktioniert.

beim schreiben dieses artikels fiel mir ein zitat ein das ich in den letzten tagen aufgeschnappt hatte. nach etwas nachdenken fiel mir ein, dass das wohl in einem video gewesen sein musste. zuerst fragte ich chatGPT, der war zu doof, aber gemini verstand mich:

promt

in diesem video spricht einer der designer von nostalgie und dass nostalgie sich eigentlich auf etwas bezieht, was in der vergangenheit der neue heisse scheiss war. findest du das zitat so, oder soll ich mal das transcript hierrein copy & pasten?

antwort

Ja, ich habe die Stelle gefunden! Das ist ein zentraler Punkt des Gesprächs zwischen Flavio Manzoni (Ferrari Chief Designer) und Jony Ive.

Das Zitat bzw. der Gedankengang findet sich vor allem im Kapitel "The Future of Ferrari" (ab ca. 17:23). Flavio Manzoni zitiert dort den Komponisten Gustav Mahler, um Ferraris Philosophie zu erklären:

"Tradition is not the worship of ashes. Tradition is the preservation of fire."

(Tradition ist nicht das Anbeten der Asche, sondern die Weitergabe des Feuers.)Zuvor (ab ca. 09:00 und später ab 18:15) führt er diesen Gedanken weiter aus: Er erklärt, dass wir heute in einer Ära mit einem sehr starken "nostalgic approach" leben, in der die Leute oft nur zurückblicken. Er betont aber, dass Ikonen wie der Ferrari F40 (der heute Inbegriff der Ferrari-Nostalgie ist) zum Zeitpunkt ihres Erscheinens extrem kontrovers und radikal neu waren.

das hätte ich auch mit leichtigkeit in 20 minuten selbst rausfinden können, indem ich in dem video rumspringe oder das transscript copy & paste und mir passende suchbegriffe ausdenke. aber sowas eine KI machen zu lassen ist schon eine echte erleichterung.

wobei es mir bei der nutzung von KI weniger ums zeitsparen geht, mit KI kann ich dinge umsetzen, die ich vorher nicht hätte umsetzen können. zeit spart das meistens nicht, weil alles was ich KI machen lässt immer nochmal 2-3 (und manchmal sehr viel mehr) korrekturläufe und neuansätze braucht. aber das ist das wesen von werkzeugen: man kann mit ihnen tolle sachen bauen, wenn man weiss was man will und was man tut.

oder umgekehrt: werkzeuge erweitern die fähigkeiten ihrer nutzer, aber auch deren fehler und irrtümer. sie ersetzen weder geschmack noch urteilsvermögen. um aus einer spanplatte etwas schönes zu machen, braucht man mehr als eine kreissäge. und die letzten jahrzehnte haben gezeigt, dass bessere werkzeuge nicht automatisch zu besseren ergebnissen führen. dank kreissägen und modernen plattenbaumaterialien hat sich die welt mit billigen, austauschbaren möbelschrott gefüllt — oder wie man heute sagen würde: spanplatten-slop.

mit mühe und sorgfalt — und im besten fall etwas geschmack und erfahrung — kann man werkzeuge aber auch nutzen um zu besseren ergebnissen zu kommen. slop ist nicht die folge von werkzeugen, sondern ihrer uninspirierten nutzung.